LLM COURSE W10第十一周TRANSFORMERS

1111310035-阮文孟

1. INTRODUCTION

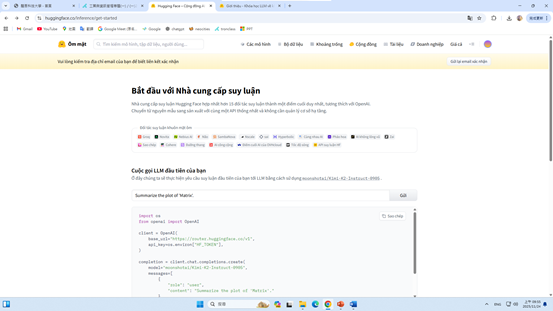

2.LLM COURSE

![]()

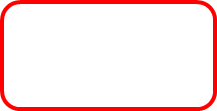

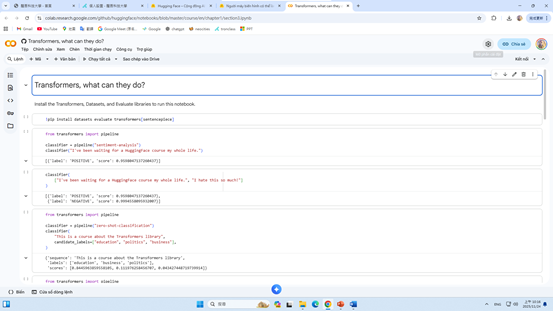

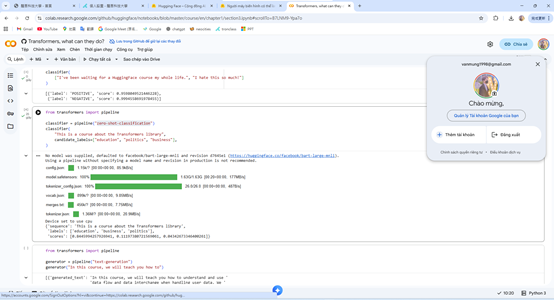

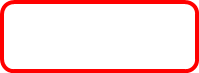

3. COLAD Transformers,_what_can_they_do_

4. Transformers,_what_can_they_do_sentiment-analysis

5. zero-shot-classification

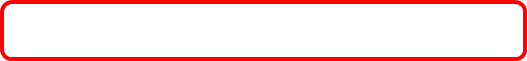

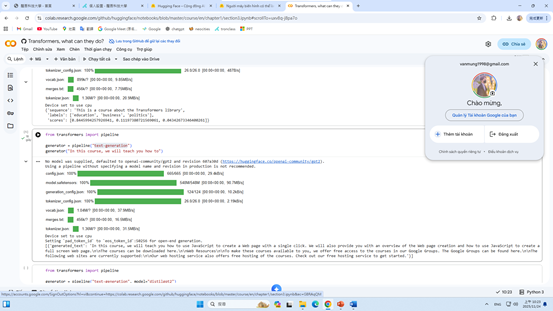

6. text-generation

6. text-generation", model="distilgpt2

text-generation (2)

max_length=30

![]()

7. Mask filling 填字

unmasker = pipeline("fill-mask")

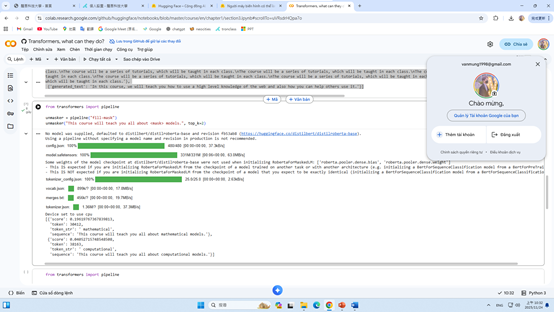

8. Ner 辨識 簡稱 PER/ORG/LOC

ner = pipeline("ner", grouped_entities=True)

ner("My name is Sylvain and I work at Hugging Face in Brooklyn.")

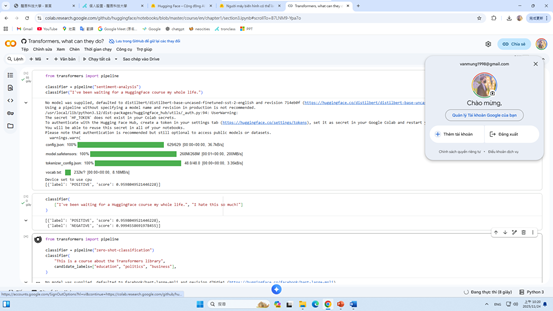

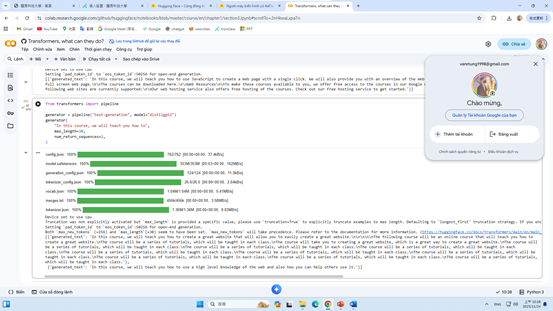

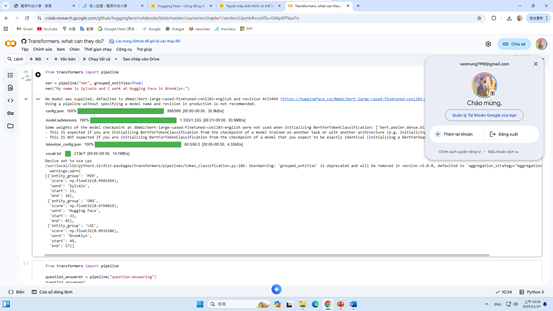

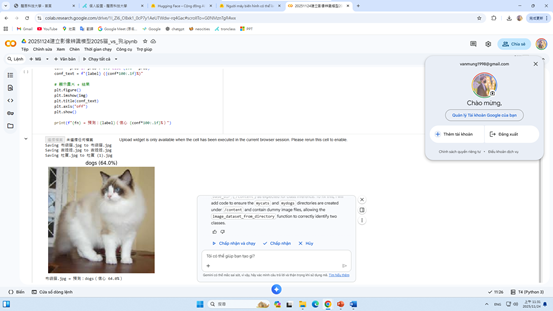

9. Image classification

from transformers import pipeline

image_classifier = pipeline(

task="image-classification", model="google/vit-base-patch16-224"

)

result = image_classifier(

"https://huggingface.co/datasets/huggingface/documentation-images/resolve/main/pipeline-cat-chonk.jpeg"

)

print(result)

![]()

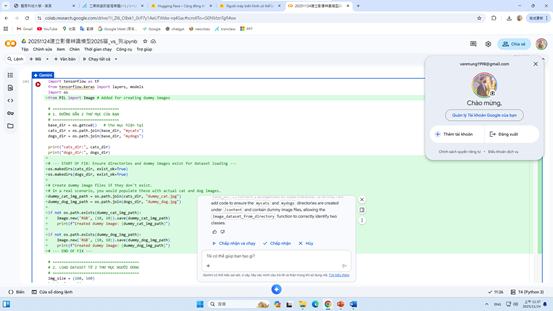

10. Transformers

在第二行我已經上傳了我自己的狗和貓的照片,但出現了錯誤,而我一直無法解決這個問題

在這次的課程中,我學到了許多與人工智慧語言模型相關的重要概念,特別是 NLP(自然語言處理)、LLM(大型語言模型)以及 Transformer 的核心架構。課程中介紹了 HuggingFace 這個平台,讓我了解到它不只是提供模型下載,也能讓使用者快速體驗各種 NLP 任務,例如情緒分析、關鍵字抽取、摘要、翻譯及影像分類等,只需要幾行程式碼就能完成,非常方便。

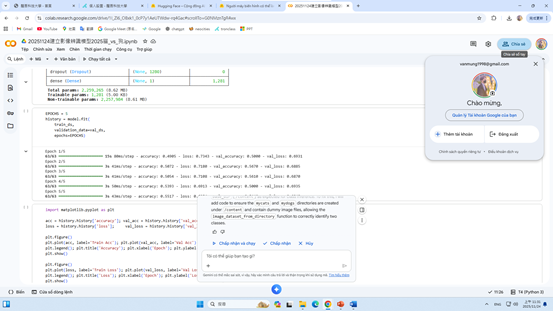

透過課堂示範,我首次理解 Transformer 的注意力機制(Attention),也明白為什麼現今主流的語言模型都採用這種架構。這讓我對 AI 如何「理解語言」有更具體的概念。課程後段的 TensorFlow/Keras 實作,也讓我體驗到自己訓練一個簡單影像分類模型的流程,包括資料集整理、模型訓練、驗證與微調。雖然實作過程不容易,但讓我獲得實際操作深度學習的寶貴經驗。

整體來說,本次課程不僅提升了我對 NLP 與 LLM 的理解,也讓我更有信心在未來繼續深入 AI 領域。